TL;DR

- La inteligencia artificial va a hacer mucho más barato generar análisis, respuestas y decisiones.

- Cuando eso ocurra, las empresas no usarán menos inteligencia. Usarán mucha más.

- Los sistemas de IA empezarán a participar en ventas, soporte, operaciones, planificación, seguimiento de clientes y gestión interna.

- El problema dejará de ser producir trabajo intelectual y pasará a ser supervisar y controlar cómo actúan esos sistemas.

- La responsabilidad no desaparecerá. Alguien seguirá teniendo que responder por cada decisión importante.

- Las empresas necesitarán mantener una imagen mucho más completa de lo que ocurre dentro de la organización.

- El contexto, la memoria y los criterios bajo los que opera la IA empezarán a convertirse en parte central de la gestión empresarial.

- Parte del management empezará a desplazarse desde coordinar personas hacia establecer cómo deben comportarse los sistemas.

- La ventaja competitiva ya no estará solo en disponer de inteligencia artificial, sino en saber gobernarla correctamente.

ARTÍCULO

Lo extraño de una IA con mayores capacidades es que aumenta la necesidad de juicio humano y este será más complejo.

Trabajar con inteligencia artificial será algo cotidiano y se usará en todas partes: para redactar correos a clientes, crear pedidos y controlar el stock óptimo, resumir llamadas de ventas, detectar oportunidades y riesgos en llamadas de clientes, solucionar incidencias de soporte o preparar reuniones. Cada acción será más barata, pero cada acción de las que hemos descrito supondrá delegar una decisión y asumir unas consecuencias, por tanto será necesario que alguien responda por ella.

Ahí es donde se desplaza el cuello de botella: la inteligencia se abarata se abarata, pero la responsabilidad no, simplemente se desplaza y aumenta.

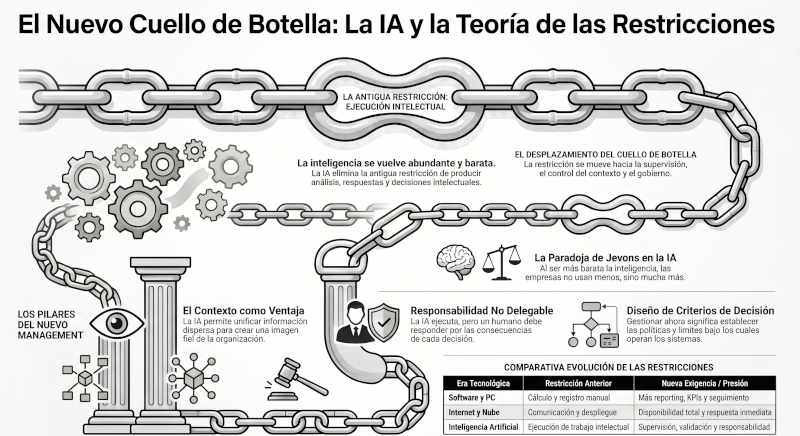

Eliyahu M. Goldratt planteaba en la Teoría de las Restricciones que optimizar una parte de un sistema no elimina los límites del sistema completo. Lo que hace es desplazar el cuello de botella hacia otro lugar. En la IA empresarial empieza a ocurrir exactamente eso. Durante años, la restricción fue ejecutar trabajo intelectual. Ahora que la inteligencia se abarata, la restricción comienza a desplazarse hacia la supervisión, el control del contexto y, cada vez más, hacia cómo se gobiernan las decisiones que toman nuestros sistemas.

Esta es la Paradoja de Jevons escondida dentro de la IA empresarial.

La historia reciente de la tecnología empresarial puede leerse como una sucesión de capacidades que se abaratan, como describe la Paradoja de Jevons, y de restricciones que se desplazan dentro de las organizaciones, como planteaba Eliyahu M. Goldratt.

Con la llegada del ordenador y la explosión del software empresarial, el problema dejó de ser realizar cálculos o registrar información manualmente. Contabilidad pudo cerrar balances más rápido, almacén pudo controlar inventario con más precisión y finanzas pudo generar informes en horas en lugar de días. Pero la consecuencia no fue simplificar las decisiones. Las empresas empezaron a pedir más reporting, más control, más seguimiento operativo, más KPIs y más capacidad de análisis sobre cada área del negocio.

Después llegó internet. Compartir información entre sedes, proveedores y clientes dejó de ser lento y costoso. Los equipos comerciales pudieron enviar propuestas en minutos, soporte pudo atender incidencias remotamente y compras pudo coordinar proveedores en tiempo real. Pero la consecuencia no fue reducir la coordinación. Las organizaciones empezaron a exigir respuestas inmediatas, disponibilidad permanente, operaciones globales y ciclos de decisión mucho más rápidos.

Más tarde aparecieron los móviles y dispositivos tipo tablet. El acceso a los sistemas dejó de depender de estar físicamente en la oficina. Un comercial podía actualizar oportunidades desde el cliente, un técnico podía cerrar incidencias desde una instalación y un responsable logístico podía consultar operaciones durante un desplazamiento. Pero la movilidad no redujo la presión operativa. Las empresas empezaron a esperar seguimiento continuo, reacción instantánea, disponibilidad constante y capacidad de supervisión en tiempo real.

Después llegó la nube. Desplegar infraestructura y conectar sistemas dejó de requerir proyectos largos y costosos. Las empresas pudieron incorporar nuevas herramientas, compartir datos entre departamentos y escalar operaciones mucho más rápido. Pero el resultado no fue simplificar las organizaciones. Lo que apareció fue más integración entre sistemas, más dependencia entre procesos y más necesidad de coordinación.

Ahora ocurre algo parecido con la inteligencia artificial. Cuando producir análisis, respuestas o decisiones deja de ser caro, las organizaciones no reducen el número de decisiones. Multiplican las preguntas, los escenarios, las validaciones y las expectativas sobre el sistema. Las incidencias de clientes pueden gestionarse con el historial completo de la cuenta; los seguimientos comerciales pueden incorporar compromisos anteriores; los equipos de producto pueden trabajar con evidencia directa de clientes; y las propuestas o decisiones pueden verificarse utilizando el histórico acumulado por la organización.

El problema se entiende fácilmente cuando la IA deja de ser una prueba aislada y empieza a formar parte de la operación diaria de la empresa. Mientras los sistemas apenas generan unas pocas recomendaciones o automatizaciones, los errores son manejables. Pero cuando los agentes empiezan a intervenir en multitud de tickets, seguimientos comerciales, validaciones internas, incidencias o decisiones operativas, la responsabilidad aumenta, una responsabilidad que alguien dentro de la organización debe asumir.

El problema no surge porque la IA falle demasiado, sino porque elimina una restricción previa. Cuando generar análisis, respuestas o decisiones deja de ser costoso, las organizaciones empiezan a utilizar inteligencia artificial en todas partes. Y entonces el cuello de botella se desplaza: la restricción ya no es producir trabajo intelectual, sino supervisar, validar y responder por el enorme volumen de acciones que el sistema es capaz de generar.

El cuello de botella es la capacidad del responsable para controlar la forma en la que se comporta el sistema. Parte del management empieza a desplazarse desde coordinar personas hacia diseñar sistemas capaces de coordinar decisiones.

En el momento en que la acción puede tener consecuencias, alguien dentro de la empresa tiene que asumir la decisión. Alguien tiene que decir: “Entiendo la base de esta acción y estoy dispuesto a responder por ella”. Esa persona puede ser un directivo, abogado, operador, ingeniero, responsable de cuenta o ejecutivo. El responsable no será quien suministra la inteligencia artificial —OpenAI, Anthropic, Mistral AI, DeepSeek o cualquier otro proveedor de modelos— sino quien tenía la responsabilidad de controlar cómo actúa esa inteligencia dentro del sistema que se ha diseñado.

Los avances van a ser enormes. Y uno de los cambios con mayor impacto será dejar atrás una de las grandes limitaciones de las organizaciones, las empresas, e incluso las personas: la dificultad de transformar información dispersa en contexto útil para tomar decisiones.

Las organizaciones acumulan datos, conversaciones, documentos, incidencias, procesos y decisiones en múltiples sistemas que rara vez funcionan como un todo coherente. Reconstruir qué ocurrió, por qué ocurrió y cómo afecta al resto de la organización sigue siendo costoso. Y por eso muchas preguntas simplemente dejan de formularse.

Hasta ahora las organizaciones no podían tener acceso al contexto, a una imagen completa de la situación porque reconstruirla era costoso y la mayoría de las veces hacerlo con cierto nivel de fidelidad respecto a la situación real era imposible. Comprender realmente qué está ocurriendo dentro de una empresa suele requerir conectar información dispersa, interpretar decisiones anteriores y reconstruir relaciones entre múltiples sistemas, personas y procesos.

La información existe, pero normalmente aparece fragmentada entre herramientas, documentos, conversaciones y operaciones que nunca fueron diseñadas para funcionar como una memoria unificada. Por eso muchas organizaciones terminan aceptando trabajar con información parcial. No porque no quieran entender mejor lo que ocurre, sino porque obtener ese contexto completo resulta demasiado caro en tiempo, coordinación y esfuerzo.

La inteligencia artificial cambia este dilema. Un sistema de inteligencia artificial puede reunir en minutos el historial de una cuenta, promesas al cliente, bloqueos sin resolver, cambios de responsables, decisiones previas, evidencias originales y estado actual. La cantidad de información que podemos manejar aumenta. Las mismas personas que antes no podían justificar el tiempo de análisis de repente querrán ese contexto, porque el coste habrá caído por debajo del umbral en el que preguntar se vuelve racional.

La demanda aparece en lugares concretos. Ventas consultará contexto incluso antes de renovaciones pequeñas y no solo en grandes acuerdos enterprise. Customer Success buscará señales de riesgo en toda la cartera de clientes. Producto querrá evidencia viva de clientes durante debates sobre roadmap en lugar de síntesis trimestrales que ya han eliminado los matices. Ingeniería querrá contexto sobre decisiones y fallos antes de cambios normales pero arriesgados. La dirección querrá señales débiles antes de que las métricas cambien, porque cuando la métrica cambia la empresa ya llega tarde.

Son ejemplos de desplazamiento de las restricciones.

Eliyahu M. Goldratt insistía en que las organizaciones no solo se deben comportar según sus intenciones, sino según sus restricciones y políticas internas. En una empresa gestionada con IA, esas políticas empiezan a convertirse en ajustes del sistema: criterios, límites de autonomía, prioridades, tolerancias al riesgo, mecanismos de validación y formas de resolver contradicciones entre objetivos.

Las incidencias y decisiones operativas pueden llegar acompañadas del historial completo de clientes, compromisos anteriores y contexto relacionado. Cada acción puede ser más barata, pero el número total de acciones aumenta.

Los sistemas basados en inteligencia artificial no eliminan restricciones organizativas. Eliminan una restricción concreta y expanden el sistema hasta que aparece otra aguas abajo. Igual que ocurrió con el software, internet, la movilidad o la nube, reducir la fricción en una parte del sistema provoca nuevas exigencias en las capas siguientes. En las organizaciones mediadas por IA, la restricción empieza a desplazarse desde la ejecución hacia el diseño de criterios de decisión, el ajuste, la validación y la supervisión.

El efecto Jevons para una empresa que aprovecha el potencial de la inteligencia artificial es simple: cuando mantienen una imagen completa de la situación, las empresas la usan más. Terminarán haciendo más preguntas, revisando más decisiones y exigiendo más evidencia alrededor de trabajos que antes se hacían con información parcial.

Lo que no cambia es que existirán responsabilidades y alguien tendrá que asumirlas. Normalmente un directivo, propietario, revisor, operador, abogado, responsable de cuenta, ingeniero o ejecutivo que debe decidir qué está dispuesto a respaldar.

Cada delegación de una acción implica una responsabilidad. Una promesa detectada al cliente obliga a una decisión humana: cumplirla, rechazarla o renegociarla. Una contradicción entre planes de producto y compromisos comerciales obliga a decidir qué verdad prevalece. Un correo redactado por IA sigue necesitando a alguien dispuesto a responder por las afirmaciones, compromisos y tono que contiene.

Pero el siguiente cuello de botella no será únicamente quién responde por una decisión, sino cómo deciden los propios sistemas. Qué contexto priorizan. Qué objetivos favorecen cuando existen conflictos. Qué riesgos aceptan. Cuándo deben recurrir a un humano. Qué señales consideran suficientes para actuar. Qué evidencia utilizan y cuál ignoran.

En las organizaciones tradicionales, muchas de estas decisiones estaban distribuidas entre cultura, procedimientos, mandos intermedios y experiencia acumulada. En las organizaciones mediadas por IA empiezan a convertirse en configuraciones operativas del sistema.

La gente suele perder de vista esta parte de la Paradoja de Jevons aplicada a la IA. El efecto rebote no es solo más uso; es más uso, más expectativas, más revisión, más trazabilidad y más responsabilidad llegando al mismo tiempo.

Y no debemos olvidar el enfoque de Goldratt. Cuando la inteligencia se abarata, el contexto, mantener una imagen fiel de la situación real, se convierte en la restricción. Cuando el contexto se abarata, la responsabilidad se convierte en la restricción. Y cuando la responsabilidad empieza a distribuirse entre humanos y sistemas, la nueva restricción pasa a ser cómo diseñamos y ajustamos los mecanismos que gobiernan las decisiones de la organización.

La ventaja competitiva ya no estará únicamente en tener mejores modelos o más automatización. Estará en comprender esta nueva forma de restricción organizativa y en diseñar correctamente los ajustes que gobiernan cómo la inteligencia se comporta y actúa dentro de la empresa.

Los ganadores no serán las empresas que automaticen más decisiones. Serán las que sepan qué decisiones pueden delegarse, cuáles requieren propiedad humana y bajo qué criterios deben operar sus sistemas. Las que entiendan que delegar en IA no depende solo de tener mejores modelos, sino de construir correctamente la memoria, el contexto y los ajustes que gobiernan cómo actúa la organización. Porque delegar inteligencia también implica asumir nuevas responsabilidades, mucho más complejas de gestionar.